发布时间:北京时间2026年4月10日

目标读者:技术入门/进阶学习者、在校学生、面试备考者、Android开发工程师

文章定位:技术科普 + 原理讲解 + 代码示例 + 面试要点

写作风格:条理清晰、由浅入深、语言通俗、重点突出

一、开篇:为什么你需要了解感情助手AI?

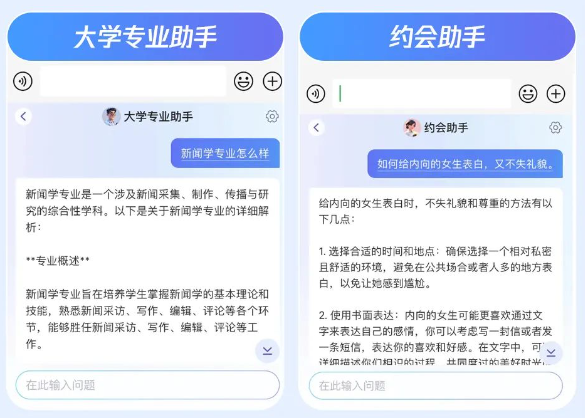

在人工智能从感知智能迈向认知智能的进程中,感情助手AI正扮演着越来越重要的角色-26。所谓“感情助手AI”,简单来说,就是能让机器通过语音、文本、表情等多模态信息,识别、理解甚至回应人类情绪情感的人工智能系统。

你可能已经在使用一些具备情感识别能力的App——比如,当你对着手机说“我今天心情不太好”,AI会给出温暖安抚的回应;或者,当客服机器人检测到用户语气愤怒时,会自动转接人工服务。这些“有温度”的交互体验,背后就是感情助手AI技术在支撑。

许多Android开发者的痛点在于:只知道调用API,却不懂底层原理;会用现成的SDK,却被面试官问得哑口无言;面对“情感计算”“Sentiment Analysis”“Emotion Recognition”等概念时常常混淆。

本文将从0到1,系统讲解感情助手AI在Android端的技术实现,涵盖核心概念、底层原理、代码示例以及高频面试题,帮你建立完整的技术知识链路。

二、痛点切入:传统实现方式的局限

在感情助手AI技术成熟之前,开发者想要让App“感知”用户情绪,通常只能靠以下方式:

// 传统方式:基于关键词的情绪判断 public String analyzeEmotion(String userInput) { if (userInput.contains("难过") || userInput.contains("伤心")) { return "negative"; } else if (userInput.contains("开心") || userInput.contains("高兴")) { return "positive"; } else { return "neutral"; } }

这种基于关键词匹配的方式,存在明显的缺陷:

语义理解弱:无法理解“我今天被老板骂了”这句话背后的负面情绪;

覆盖面窄:只能识别预设的关键词,无法泛化到未知表达;

缺乏深度:无法感知情绪的强度和细微变化;

难以扩展:每新增一种情绪表达,都需要手动补充关键词库。

这种“死板的规则匹配”显然无法满足用户对智能交互的期待,这也正是感情助手AI技术出现的根本原因。

三、核心概念讲解:情感分析(Sentiment Analysis)

定义

情感分析(Sentiment Analysis,简称SA),也称观点挖掘,是自然语言处理(NLP)的一个子领域,旨在自动化从文本中识别和提取情感信息,对给定文本的情感极性进行分类——识别其潜在态度是积极、消极还是中性-49。

拆解关键词

情感极性(Polarity) :判断文本的情绪倾向,通常分为正面、负面、中性三类。

强度(Intensity) :衡量情绪的强弱程度,如“有点开心” vs “非常开心”。

目标(Target) :识别情绪指向的对象(如“我喜欢这个功能”中的“这个功能”)。

生活化类比

想象你有一个朋友,你说话时他能从你的语气和用词中判断你现在的心情。情感分析就是这个朋友的角色——它“听”你说的话,然后告诉你:“他听起来有点生气”或“他现在心情不错”。

核心价值

感情助手AI的核心价值在于:让人机交互从“冷冰冰的命令响应”升级为“有温度的共情对话”-69。当AI能够感知用户的情绪状态时,它可以:

在客服场景中,愤怒时自动升级人工客服;

在教育场景中,学生困惑时主动提供额外解释;

在心理健康场景中,持续低落时触发医生预警-44。

市场前景

据Fortune Business Insights报告,全球情感人工智能市场规模2025年为34亿美元,预计到2034年将增长至207.7亿美元,年复合增长率高达22.29%-16。这一强劲增长说明感情助手AI已成为AI产业的重要赛道。

四、关联概念讲解:情感识别(Emotion Recognition)

定义

情感识别(Emotion Recognition)是情感计算的核心任务,指通过分析语音语调、面部表情、生理信号等多模态数据,识别出具体的情感类别(如喜、怒、哀、惧、惊等)。

与情感分析的关系

| 维度 | 情感分析(Sentiment Analysis) | 情感识别(Emotion Recognition) |

|---|---|---|

| 粒度 | 粗粒度:正面/负面/中性 | 细粒度:喜/怒/哀/惧/惊/厌 |

| 数据来源 | 以文本为主 | 文本 + 语音 + 图像 + 生理信号 |

| 输出结果 | 极性 + 强度 | 具体情绪标签 + 置信度 |

| 典型场景 | 产品评论分析、舆情监控 | 语音助手情感响应、驾驶员状态监测 |

一句话概括

情感分析是“说人话”(判断态度好坏),情感识别是“读人心”(识别具体情绪) ——两者相辅相成,共同构成感情助手AI的核心能力。

简单示例:语音情感识别的工作机制

ZEGO即构科技的AI Agent平台提供了语音情绪识别能力,开启后,AI Agent会根据用户的原始音频分析情绪(如恐惧、开心、愤怒等),并将识别结果添加到请求LLM的用户提示词中,让AI更好地理解用户情绪-2。这种“端侧感知+云端增强”的架构,正是当前Android端感情助手AI的主流实现模式。

五、概念关系与区别总结

感情助手AI涉及的核心概念体系如下:

┌─────────────────────────────────────────────────────────────┐ │ 情感计算(Affective Computing) │ │ —— 让机器理解、处理、模拟情感 │ └─────────────────────────────────────────────────────────────┘ │ ┌────────────────────┼────────────────────┐ ▼ ▼ ▼ ┌─────────────┐ ┌─────────────┐ ┌─────────────┐ │ 情感分析 │ │ 情感识别 │ │ 情感生成 │ │(判断好坏) │ │(识别类别) │ │(共情回应) │ └─────────────┘ └─────────────┘ └─────────────┘

记忆口诀:情感计算是“总纲”,情感分析和情感识别是“两翼”,前者重文本极性判断,后者重多模态情绪分类。

六、代码/流程示例:在Android端实现文本情感分析

下面以一个基于MobileBERT模型的Android端文本情感分析为例,演示完整的实现流程。

6.1 技术选型说明

本示例采用MobileBERT模型——BERT_LARGE的精简版本,通过瓶颈结构和自注意力与前馈网络的平衡设计,在保持较高精度的同时显著减小模型体积,非常适合端侧部署-38-42。模型在GLUE基准的SST2(斯坦福情感树库)数据集上进行了微调,用于执行设备上的情感分析-38。

6.2 完整代码实现

// 1. 在build.gradle中添加依赖 dependencies { // TensorFlow Lite for Android implementation 'org.tensorflow:tensorflow-lite:2.14.0' // 可选:使用GPU代理加速 implementation 'org.tensorflow:tensorflow-lite-gpu:2.14.0' } // 2. 情感分析工具类 public class SentimentAnalyzer { private static final String MODEL_PATH = "mobilebert_sst2.tflite"; private static final int MAX_SEQ_LEN = 128; private Interpreter tflite; private NativeInterpreterWrapper wrapper; // 初始化:加载模型 public boolean loadModel(Context context) { try { ByteBuffer modelBuffer = loadModelFile(context); Interpreter.Options options = new Interpreter.Options(); // 开启GPU加速(可选) options.setUseGpuDelegate(true); tflite = new Interpreter(modelBuffer, options); return true; } catch (IOException e) { e.printStackTrace(); return false; } } // 核心方法:分析情感 public SentimentResult analyze(String text) { // Step1: 文本预处理——Tokenization int[] inputIds = tokenize(text, MAX_SEQ_LEN); int[] attentionMask = createAttentionMask(text, MAX_SEQ_LEN); // Step2: 构建输入张量 int[][][] inputArray = new int[1][MAX_SEQ_LEN][1]; for (int i = 0; i < MAX_SEQ_LEN; i++) { inputArray[0][i][0] = inputIds[i]; } // Step3: 执行推理 float[][] output = new float[1][2]; // 2分类:正面/负面 tflite.run(inputArray, output); // Step4: 解析结果 float positiveScore = output[0][1]; float negativeScore = output[0][0]; String sentiment = positiveScore > negativeScore ? "POSITIVE" : "NEGATIVE"; float confidence = Math.max(positiveScore, negativeScore); return new SentimentResult(sentiment, confidence); } // 辅助方法:加载模型文件(从assets目录) private ByteBuffer loadModelFile(Context context) throws IOException { AssetFileDescriptor fileDescriptor = context.getAssets().openFd(MODEL_PATH); FileInputStream inputStream = new FileInputStream(fileDescriptor.getFileDescriptor()); FileChannel fileChannel = inputStream.getChannel(); long startOffset = fileDescriptor.getStartOffset(); long declaredLength = fileDescriptor.getDeclaredLength(); return fileChannel.map(FileChannel.MapMode.READ_ONLY, startOffset, declaredLength); } }

6.3 执行流程解析

模型加载:将预训练的MobileBERT模型(.tflite格式)放入assets目录,App启动时加载到内存;

文本预处理:将用户输入文本转换为模型可接受的token序列(input_ids)和注意力掩码(attention_mask);

模型推理:TensorFlow Lite Interpreter执行神经网络计算,输出两个类别的概率分数;

结果解析:比较正面和负面概率,取最大值对应的类别作为最终结果;

业务响应:根据情感分析结果触发相应的UI或对话逻辑。

关键优化点:推荐使用高通Snapdragon 8 Gen 2及以上系列手机进行测试,以获得最佳推理性能-42。

七、底层原理与技术支撑

感情助手AI的底层依赖三个核心技术支柱:

7.1 深度学习模型

现代情感分析系统利用深度学习(DL)架构,特别是Transformer模型,来理解语境、讽刺和细微差别。这些模型通过神经网络的复杂层处理输入数据,为每个情感类别生成概率分数-49。

语音情感识别则采用CRNN(卷积循环神经网络)架构,通过卷积层提取局部特征,LSTM层捕捉时序依赖,全连接层完成分类。实验表明,在IEMOCAP数据集上,CRNN模型比传统SVM方法提升14.2%的F1分数-44。

7.2 端侧推理引擎

Android端部署AI模型,主要依赖TensorFlow Lite、PyTorch Mobile、MediaPipe、MNN、NCNN等推理引擎-60。这些引擎负责将训练好的模型转换为移动端可运行的格式,并利用GPU、DSP、NPU等硬件加速推理。

高通Snapdragon平台提供的Neural Processing SDK可以将TensorFlow Frozen Graph转换为DLC(Deep Learning Container)格式,以在DSP、GPU和CPU加速器上进行高效推理-42。

7.3 JNI/NDK性能优化

在Android端部署情感识别模型时,JNI/NDK起着关键作用:

AI推理引擎的核心计算逻辑(如矩阵乘法)由C/C++编写,通过JNI调用可获得最高硬件性能;

音频预处理(FFT)、图像处理(OpenCV)等计算密集型任务也通过Native层执行;

高效数据交换:避免频繁的Java⇄Native数据拷贝,采用直接缓冲区(DirectByteBuffer)传递张量数据-60。

一句话总结:感情助手AI = 深度学习模型(算法核心)+ 端侧推理引擎(工程载体)+ 硬件加速(性能保障)。

八、高频面试题与参考答案

面试题1:在Android平台上开发AI应用与开发普通应用的核心区别是什么?

参考答案(建议从以下维度分层回答):

计算范式不同:普通应用是I/O密集型,AI应用是计算密集型和内存密集型,涉及大量矩阵运算;

资源消耗差异:AI应用重度依赖GPU/DSP/NPU加速,模型占用几十MB至几百MB内存,OOM风险高,功耗控制是关键指标-60;

异步设计要求高:单次推理可能耗时数百毫秒甚至数秒,必须使用协程/线程池避免阻塞UI;

数据处理复杂:需将原始数据(图片/音频/文本)转换为张量(Tensor),涉及归一化、重采样等预处理逻辑;

部署依赖不同:需处理推理引擎的.so文件ABI兼容性问题(arm64-v8a、armeabi-v7a);

隐私安全优先:端侧AI优势在于数据不出设备,需确保敏感数据不会被泄露-60。

踩分点:按“计算范式→资源消耗→异步设计→数据处理→部署依赖→隐私安全”六个维度展开,回答完整且有层次。

面试题2:请简述情感分析和情感识别的区别。

参考答案:

| 维度 | 情感分析 | 情感识别 |

|---|---|---|

| 粒度 | 粗粒度(正面/负面/中性) | 细粒度(喜/怒/哀/惧/惊/厌) |

| 数据来源 | 以文本为主 | 多模态(文本+语音+图像+生理信号) |

| 输出 | 极性+强度 | 具体情绪标签+置信度 |

| 典型应用 | 评论分析、舆情监控 | 语音助手情感响应、驾驶员监测 |

一句话总结:情感分析判断“态度好坏”,情感识别识别“具体情绪”。

面试题3:Android端部署情感识别模型时如何优化性能?

参考答案:

模型轻量化:使用MobileBERT、TinyBERT等轻量模型,或通过量化(INT8)减少模型体积-38;

硬件加速:启用TensorFlow Lite的GPU代理(

options.setUseGpuDelegate(true)),或利用高通NP SDK调用DSP/NPU加速;异步推理:使用Kotlin协程或线程池将推理任务置于后台线程,避免阻塞UI;

预处理优化:将预处理逻辑(如音频重采样、图像缩放)移至Native层,减少Java⇄Native数据拷贝;

模型缓存:将加载后的模型实例缓存为单例,避免重复加载。

面试题4:Android端语音情感识别的技术流程是怎样的?

参考答案:

音频采集:通过

AudioRecordAPI以48kHz采样率捕获用户语音;预处理:降噪(谱减法)、VAD端点检测分割语音片段;

特征提取:提取MFCC(梅尔频率倒谱系数)、基频、能量、语速等声学特征-44-69;

模型推理:输入特征到CRNN或Transformer模型,输出7类基本情绪的概率分布;

结果处理:将识别出的情绪标签作为上下文注入到LLM提示词中,让AI生成更共情的回应-2。

面试题5:TensorFlow Lite在Android端部署AI模型的核心步骤?

参考答案:

模型转换:将训练好的模型(TensorFlow SavedModel/ PyTorch模型)转换为.tflite格式;

添加依赖:在

build.gradle中添加tensorflow-lite和tensorflow-lite-gpu依赖;放入资源:将.tflite模型文件放入

assets目录;加载模型:使用

Interpreter类加载模型文件;数据预处理:将输入数据转换为模型需要的张量格式;

执行推理:调用

interpreter.run(input, output);解析输出:将输出张量转换回业务可读的结果格式。

九、结尾总结

全文核心知识点回顾

| 章节 | 核心要点 |

|---|---|

| 概念辨析 | 情感分析(文本极性)+ 情感识别(具体情绪)= 感情助手AI核心能力 |

| 技术栈 | 深度学习模型(Transformer/CRNN)+ 端侧推理引擎(TFLite)+ 硬件加速 |

| 实现流程 | 采集→预处理→特征提取→模型推理→结果输出→业务响应 |

| 面试重点 | AI应用与普通应用6维区别、情感分析vs情感识别、Android端性能优化 |

重点强调

⚠️ 概念别混淆:情感分析≈文本极性判断;情感识别≈多模态情绪分类

⚠️ 面试高频:AI应用与普通应用的区别(计算范式、资源消耗、异步设计、数据处理、部署依赖、隐私安全)是必考方向

⚠️ 工程要点:端侧推理务必注意内存管理(OOM风险)和功耗控制

进阶预告

下一篇,我们将深入讲解Android端语音情感识别的完整工程实践,包括AudioRecord配置、VAD算法实现、CRNN模型部署与调优,以及如何将情感识别能力无缝接入对话系统,敬请期待!

本文参考资料:Fortune Business Insights 2026年情感AI市场报告、ZEGO AI Agent技术文档、TensorFlow Lite官方文档、Qualcomm Neural Processing SDK技术文档等。